如何在飞书智能伙伴搭建平台上接入硅基流动(siliconflow)的 Qwen 2.5

硅基流动为开发者提供了多种模型的部署能力,开发者可以无痛的调用不同的模型。

硅基流动作为国内的 AI Infra 创业公司,给开发者提供了丰富的模型调用能力,开发者可以在硅基流动上找到不同的模型并无痛的调用。

接下来,跟着我一起把硅基流动上的 QWen 2.5 配置到飞书智能伙伴搭建平台上。

创建硅基流动 API Key

首先,访问硅基流动开放平台,访问「API 密钥」页面

点击「新建 API 密钥」,为你的飞书智能伙伴平台创建一个全新的 Key,以便于后续按 Key 来管理。

配置模型

复制生成的 Key,进入到飞书智能伙伴搭建平台的企业管理后台。

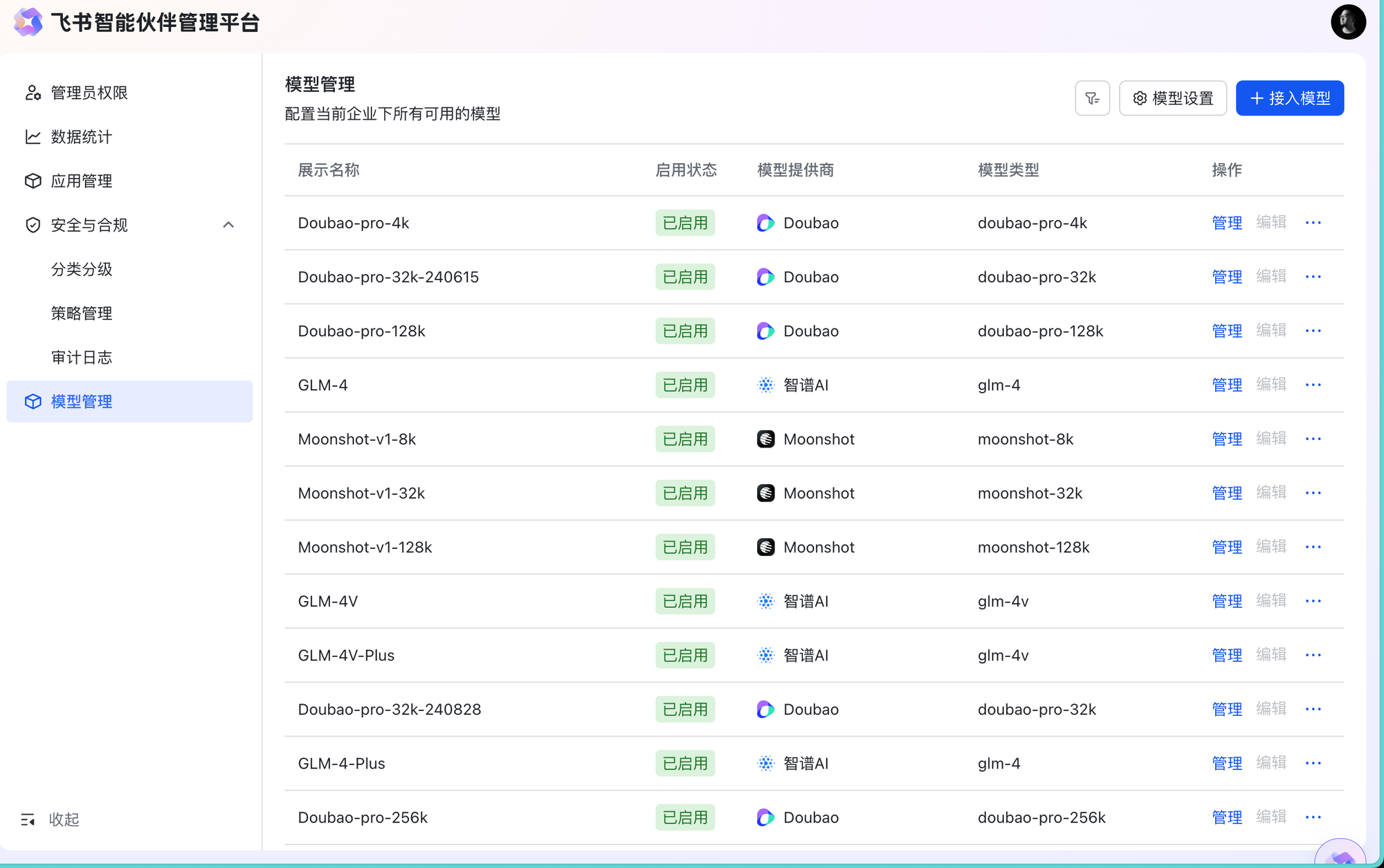

在管理后台进入模型管理页面,可以看到飞书智能伙伴搭建平台提供的默认模型,这部分模型只能管理是否可用,但无法配置 Key(你如果用完了 Quota,可以直接购买 Quota)。如果你需要配置自己的 Key,则需要按照接入模型的指南,对应进行接入。

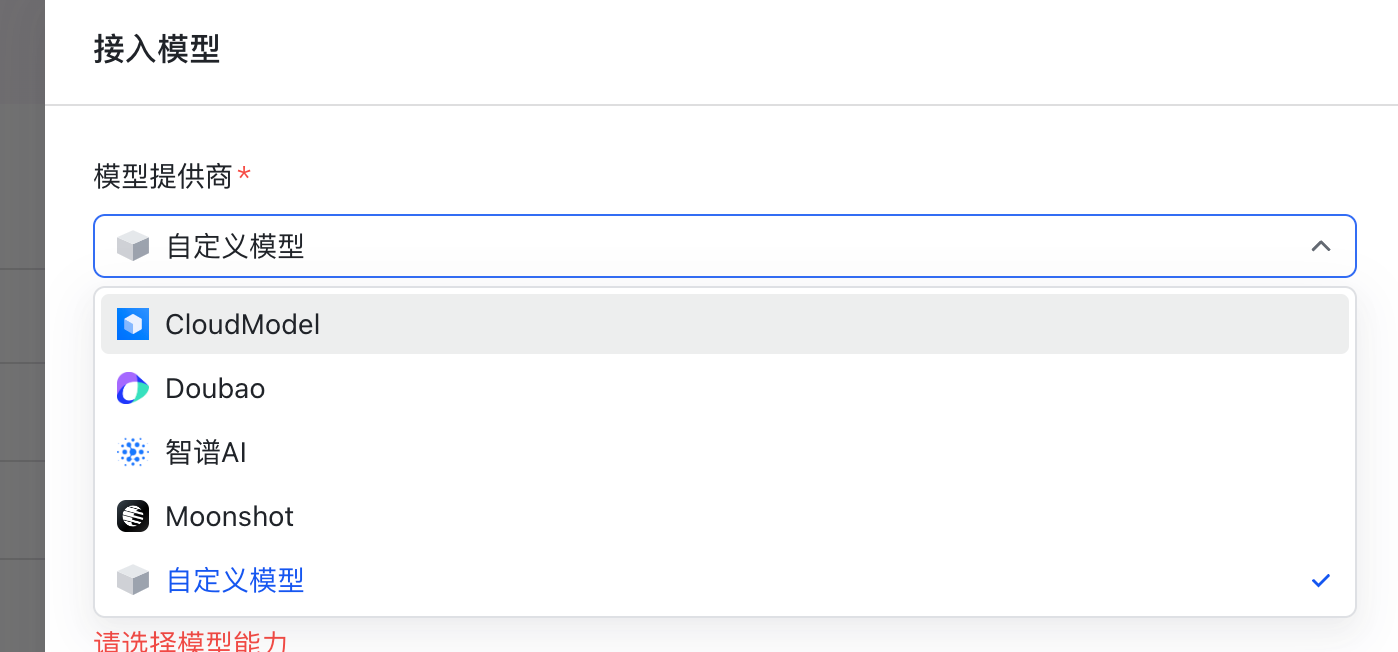

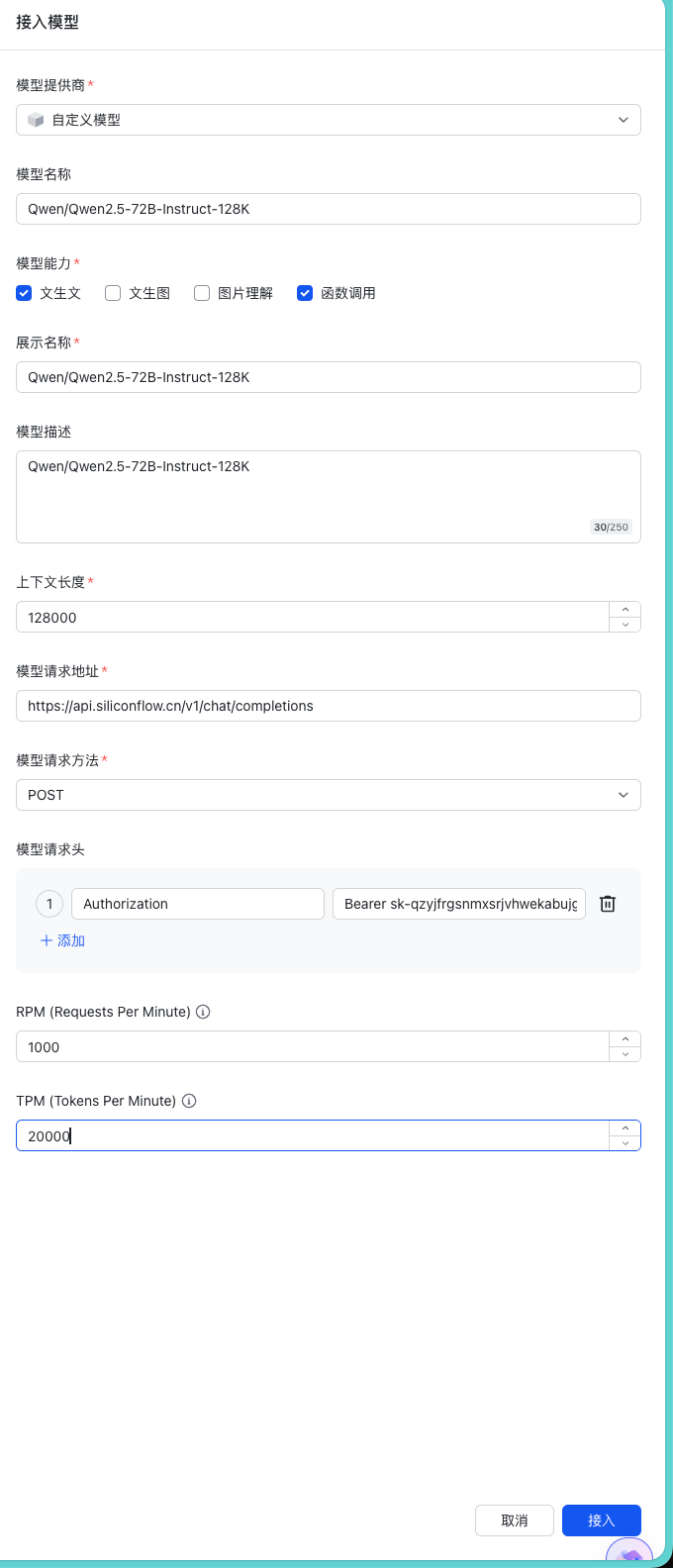

点击右上角的「接入模型」,并在弹出的窗口中,选择模型供应商为「自定义模型」,

然后依次如下填写:

- 模型名称:

Qwen/Qwen2.5-72B-Instruct-128K - 模型能力:勾选「文生文」和「函数调用」

- 展示名称和模型描述:根据你自己的喜好填写,这个不影响 API 调用,主要是在选模型列表时会有影响。

- 上下文长度:

1280000 - 模型请求地址:

https://api.siliconflow.cn/v1/chat/completions - 模型请求方法:

POST - 模型请求头:新增一个请求头

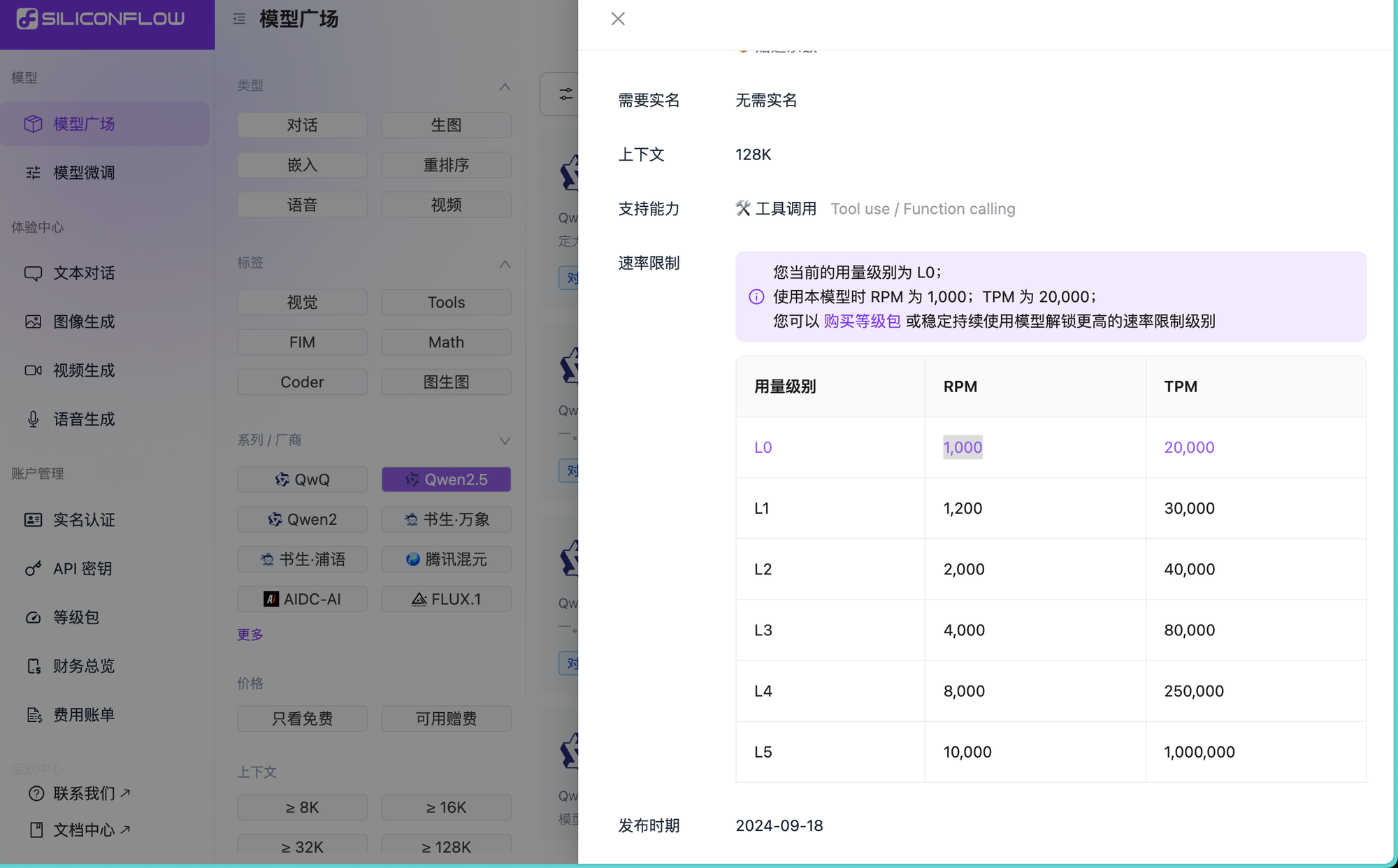

Authorization,其值为Bearer 你的TOKEN - TPM (Tokens Per Minute):查看模型广场上的 Qwen 2.5 的具体速率限制,根据你当前的等级进行填写。

- RPM (Requests Per Minute):查看模型广场上的 Qwen 2.5 的具体速率限制,根据你当前的等级进行填写。

填写完成后,大概是这样的:

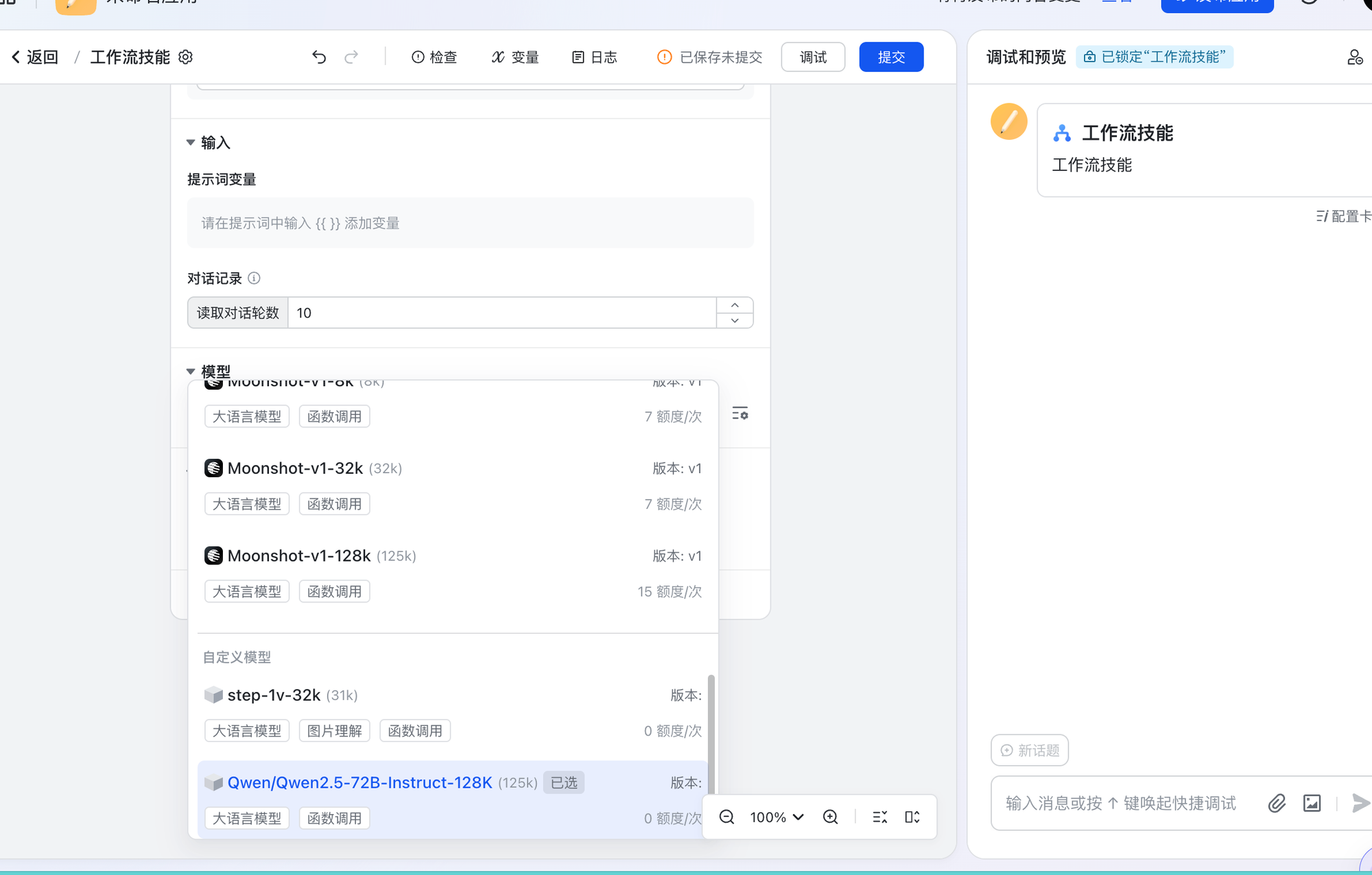

提交完成后,就可以看到你刚刚配置的模型了。接下来就可以在应用当中使用它了~

使用 step-1v-32k 模型示意图

注意

如果你希望整个平台的所有部分都使用硅基流动的模型,则需要点击「模型管理」页面的「模型设置」,将默认模型和替换模型设置为硅基流动模型,这样后续所有逻辑就都会默认使用硅基流动的模型。